GPT의 시대입니다.

하루가 다르게 다양한 기술들이 나오고 있습니다

GPT plugin 이 개발되어 적시성을 필요로하는 데이터도 바로바로 GPT를 통해 볼 수 있게되고

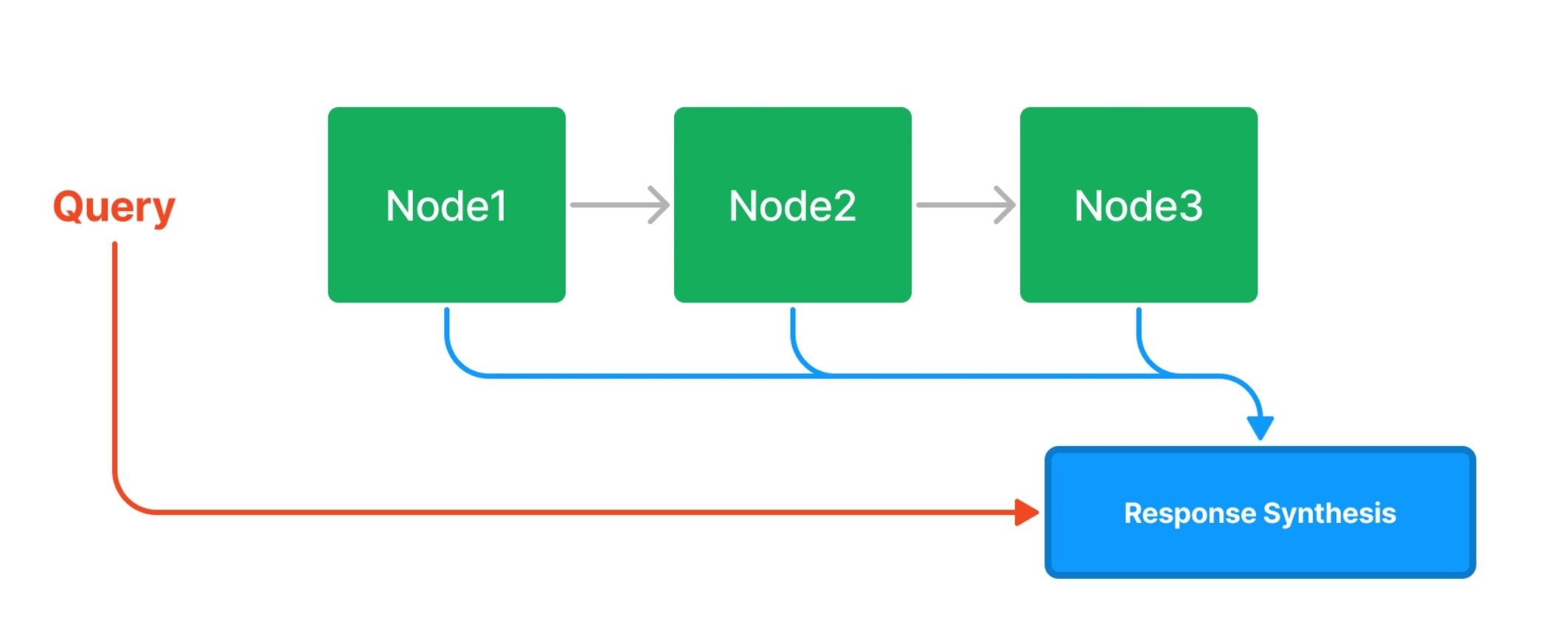

GPT-Index(LLaMa-index)를 통하여

PDF, 위키피디아, 노션등을 바로 검색하여 답하게 할 수 도 있게되었습니다!

하지만 대부분의 방법은 OpenAI의 GPT-3, chatGPT, GPT-4 등을 활용하는 방법인데요~!

산이 높으면 그늘도 깊은법!!

화려한 GPT의 능력 때문에 다양한 곳에 활용될 수도 있으나

정보유출이 가장 큰 문제로 대두되고 있습니다!

최근에는 삼성전자에서 GPT를 통하 중요 정보가 유출되는 사건이 발생하기도 했구요!

https://economist.co.kr/article/view/ecn202303300057

[단독] 우려가 현실로…삼성전자, 챗GPT 빗장 풀자마자 ‘오남용’ 속출

우려가 현실이 됐다.삼성전자가 디바이스솔루션(DS·반도체) 부문 사업장 내 챗GPT(ChatGPT) 사용을 허가하자마자 기업 정보가 유출되는 사고가 났다.

economist.co.kr

이에 최근에는 여러 기업들이 Open Source를 통해 GPT 모델을

인트라넷 환경 내에서 즉 On-premise로 구축하고자하는 시도가 있는데요!!

아쉽게도 OpenAI의 GPT들의 경우 Open Source가 아니어 API 방식으로만 활용이 가능한 상황이니다.

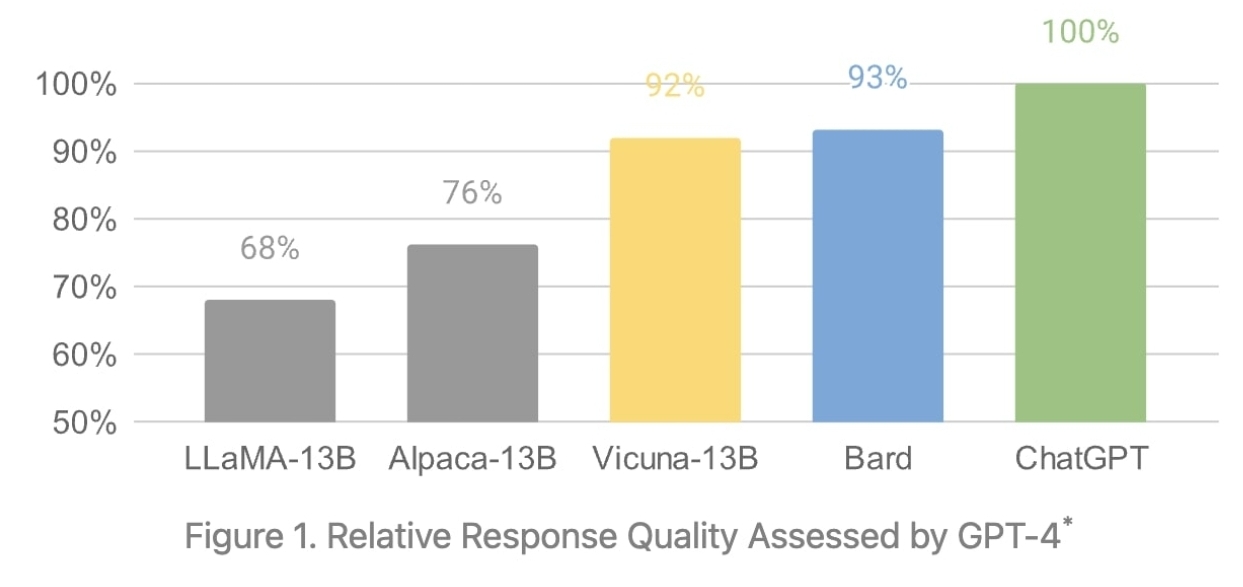

하지만 메타에서는 LLaMA를 오픈소스로 공개하였고,

이후 해당 모델을 기반으로하는 다양한 Open Source들이 공개되어 요약해보았습니다!

| 모델명 | 개발사 | OpenSource | 경쟁모델 | parameter 수(bn) | 특이사항 |

| GPT-3 | OpenAI | X | - | 175 | davinci, curie 등 세부 모델 존제 |

| GPT-4 | OpenAI | X | - | 1,000 | 32K / 8K context로 구분 |

| Bard | X | chatGPT | |||

| LLaMa | Meta | O | GPT3 | 65 | 2/23출시. 65B.33B.7B 모델로 구분 (숫자가 Parameter수) |

| Cerebras GPT | Cerebras | O | GPT3 | 13 | 7개 버젼 존재 13B, 6.7B, 2.7B, 1.3B, 590M, 256M, 111M |

| gpt4all | O | GPT3 | 7 | LLaMA-7B 기반, | |

| Alapaca | Stanford | O | ChatGPT | 7 / 13 | LLaMA-7B 기반, GPT-3 데이터로 추가 학습 진행 ($600 ) |

| VIcuna | UC berkley 등 | O | GPT-4 | 13 | LaMA-7B 기반, GPT-3 데이터로 추가 학습 진행 ($300 ) |

하루가 다르게 발전하는 LLM 분야가 앞으로 어떻게 바뀔지 기대되네요!!

'데이터&AI > LLM' 카테고리의 다른 글

| chatgpt 스토어를 알아보쟈!! (1) | 2024.01.15 |

|---|---|

| llamafile 포트 및 ip 정보 바꾸기!! (0) | 2023.12.27 |

| ollama 의 모델 저장 디렉토리 바꾸기!! (0) | 2023.12.26 |

| LLM 모델 팔콘 알아보기 (Falcon-180b) (1) | 2023.12.02 |

| 초거대언어모델(LLM) 의 성능평가지표 (feat. MMLU, Helloswag) (1) | 2023.12.01 |

댓글